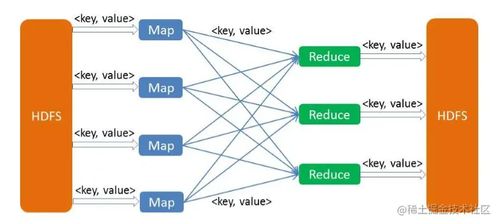

MapReduce是一種經典的大數據處理編程模型和框架,最初由Google提出,后來在Hadoop生態系統中得到廣泛應用。它通過將大規模數據處理任務分解為Map(映射)和Reduce(歸約)兩個階段,實現了分布式計算的并行處理。在本文中,我們將詳細解析MapReduce的核心原理、工作流程、優勢與局限性,并結合實際應用場景進行探討。

一、MapReduce核心原理

MapReduce模型基于函數式編程思想,將數據處理任務分為兩個主要階段:

1. Map階段:輸入數據被分割成多個獨立塊,每個塊由一個Map任務處理,生成中間鍵值對(key-value pairs)。

2. Reduce階段:中間結果根據鍵進行分組和聚合,由Reduce任務處理,最終輸出結果。

該框架自動處理數據分布、任務調度和容錯,開發者只需關注業務邏輯實現。

二、工作流程詳解

- 輸入分片:數據被分割成固定大小的分片,每個分片分配給一個Map任務。

- Map階段:每個Map任務處理一個分片,應用用戶定義的Map函數,生成中間鍵值對。

- Shuffle和排序:中間數據根據鍵排序并分發到相應的Reduce節點。

- Reduce階段:每個Reduce任務處理一組鍵,應用用戶定義的Reduce函數,聚合結果。

- 輸出:最終結果寫入分布式文件系統(如HDFS)。

三、MapReduce的優勢與局限性

優勢:

- 高擴展性:可輕松擴展至數千節點處理PB級數據。

- 容錯性:自動處理節點故障,重新執行失敗任務。

- 簡單編程模型:開發者無需關注底層分布式細節。

局限性:

- 不適合實時處理:批處理模式導致高延遲。

- 中間數據寫入磁盤:影響性能,尤其對于迭代計算。

- 復雜性較高任務需多次MapReduce作業。

四、實際應用場景

- 日志分析:處理Web服務器日志,統計訪問頻率或錯誤率。

- 搜索引擎:構建倒排索引,用于網頁排名。

- 數據挖掘:執行聚類或關聯規則挖掘,如購物籃分析。

- 機器學習:訓練大規模模型,如協同過濾推薦系統。

五、與聯網信息服務的結合

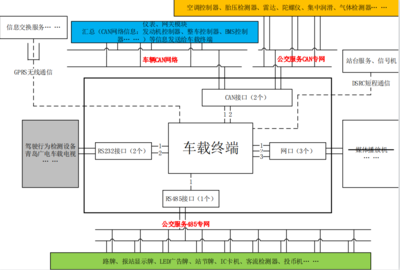

在聯網信息服務中,MapReduce可用于:

- 用戶行為分析:處理用戶交互數據,優化服務推薦。

- 網絡監控:分析流量日志,檢測異常模式。

- 內容聚合:整合多源數據,生成個性化摘要。

通過集成Hadoop生態系統工具(如Hive或Pig),可進一步提升開發效率。

盡管新興框架(如Spark)在性能上有所超越,MapReduce作為大數據處理的基石,其思想和架構仍深刻影響著分布式計算領域。對于歷史數據批處理和教學理解,它依然具有重要價值。在實際應用中,結合具體需求選擇合適的框架是關鍵。